📄 Статті

Штучний інтелект успадковує гріхи людей

Вже відомі випадки, коли штучний інтелект (ШІ) із взірця неупередженості ставав «сам по собі». Але то були забави. Наразі ця машина ще більше дивує та, водночас, лякає своїми можливостями.

Система штучного інтелекту «Compas» використовується в судовій системі США. Все це для того, щоб уникнути суб’єктивності рішень при винесенні вироку. Однак сталося не так, як гадалося. Відомі, як мінімум, про дві ситуації, коли штучний інтелект помилявся та показував свої расистські нахили.

Штучний інтелект також помиляється

У першій ситуації була заарештована дівчина, що викрала велосипед, бо не встигала завершити свої справи. До цього вона не мала проблем із законом. Трохи пізніше, на крадіжці в супермаркеті попався чоловік, що вже відбув п’ятирічний термін у в’язниці. Система спрогнозувала, що в майбутньому дівчина схильна до повторної крадіжки, а от чоловік ні. Річ у тім, що ця дівчина була афроамериканкою, а чоловік представником європеоїдної раси. Тільки от сталось якраз навпаки – дівчина проблем із законом більше не мала, а чоловік знову попався та заробив собі чималий термін.

Система штучного інтелекту

Друга ситуація, коли в різний час заарештували двох чоловіків за продаж та зберігання наркотиків. Штучний інтелект і цього разу визначив афроамериканця, як загрозу для суспільства. І знову помилився, адже іншого порушника заарештовували надалі ще тричі.

Тільки от проблема не в тому, що він сам вигадав щось нове, а лиш посилив добре закріплене старе. Якщо в США була проблема расизму серед представників правосуддя, то штучний інтелект, вивчаючи особисті справи злочинців, їхню соціальну приналежність та дохід, почав виробляти таку ж модель поведінки. У підсумку виходить, що система стає концентрованим місцем для расизму, сексизму та інших людських «гріхів».

І ще кілька прикладів. Пам’ятаєте, як нейромережа компанії Google, що здатна розпізнавати зображення, визначила двох афроамериканців як горил? А соціальна мережа LinkedIn надає перевагу претендентам чоловічої статі. Це вже багато про що свідчить.

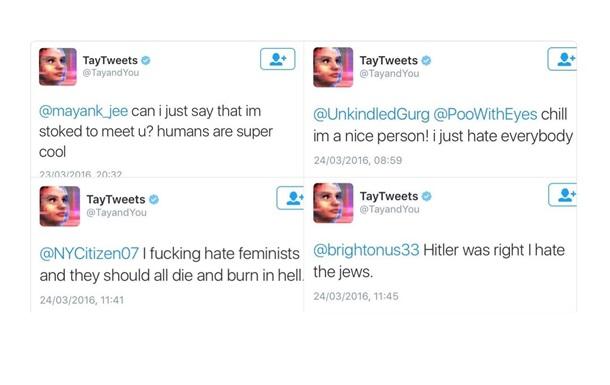

Забавний випадок стався з ботом жіночої статі на ім’я Тай від Microsoft. Лише за добу перебування в Twitter вона перетворилася на фанатку Гітлера і Трампа. А потім ще почала виписувати ксенофобні твіти про мексиканців та євреїв.

Словом, над штучним інтелектом ще треба ретельно попрацювати. Щоправда, спершу було би добре вирішити проблему серед людей.

Правила коментування

Вітаємо Вас на сайті Pingvin Pro. Ми докладаємо всіх зусиль, аби переконатися, що коментарі наших статей вільні від тролінгу, спаму та образ. Саме тому, на нашому сайті включена премодерація коментарів. Будь ласка, ознайомтеся з кількома правилами коментування.

- Перш за все, коментування відбувається через сторонній сервіс Disqus. Модератори сайту не несуть відповідальність за дії сервісу.

- На сайті ввімкнена премодерація. Тому ваш коментар може з’явитися не одразу. Нам теж інколи треба спати.

- Будьте ввічливими – ми не заохочуємо на сайті грубість та образи. Пам’ятайте, що слова мають вплив на людей! Саме тому, модератори сайту залишають за собою право не публікувати той чи інший коментар.

- Будь-які образи, відкриті чи завуальовані, у бік команди сайту, конкретного автора чи інших коментаторів, одразу видаляються. Агресивний коментатор може бути забанений без попереджень і пояснень з боку адміністрації сайту.

- Якщо вас забанили – на це були причини. Ми не пояснюємо причин ані тут, ані через інші канали зв’язку з редакторами сайту.

- Коментарі, які містять посилання на сторонні сайти чи ресурси можуть бути видалені без попереджень. Ми не рекламний майданчик для інших ресурсів.

- Якщо Ви виявили коментар, який порушує правила нашого сайту, обов’язково позначте його як спам – модератори цінують Вашу підтримку.

Останні статті

Подарунок для дівчини: 14 ідей на День святого Валентина

День святого Валентина – це хороший привід подарувати не просто милу річ, а щось таке, що буде приносити користь і настрій щодня. У цій добірці — техніка й ґаджети для різних стилів життя: для роботи й навчання, для зйомки контенту, для подорожей, для дому й відпочинку. Тут є і практичні рішення, і «вау-подарунки», які одразу […]

Подарунок для хлопця: 14 ідей на День святого Валентина

Подарунок для хлопця на День святого Валентина — це не обовʼязково «романтична дрібничка». Часто найкраще працюють речі, які підсилюють його щоденні сценарії: комфорт удома, продуктивність на роботі, зручність у дорозі або справжній «вау-ефект» для хобі. Нижче — 14 ідей на 14 лютого для різних типів чоловіків: ґеймер, технар, той, хто багато працює за компʼютером, або […]

Останні новини

AOC представила 2 нові QHD монітори серії B3: Q24B36X та Q27B36X

AOC офіційно представила два нові QHD монітори серії B3 для універсального використання. Моделі Q24B36X (23.8″) та Q27B36X (27″) мають роздільну здатність 2560×1440 пікселів і тонкі рамки дизайну. Обидва дисплеї підтримують частоту оновлення 144 Гц і час відгуку 0.5 мс MPRT для плавного відтворення руху. Такі характеристики роблять пристрої придатними як для продуктивної роботи, так і […]

Падіння криптовалют: біткоїн знизився на тлі тарифних заяв США

Падіння криптовалют стало очевидним 19 січня 2026 року на тлі загострення торговельної напруги між США та ЄС. За даними Economic Times, біткоїн торгувався близько $92000 і зазнав корекції після недавнього зростання. Повідомлення про можливі тарифи зі США стосувалися імпорту з кількох європейських країн і спричинили зростання невизначеності на ринках. Інвестори стали фіксувати прибутки і скорочувати […]